Zum Inhalt springen

- {{#headlines}}

- {{title}} {{/headlines}}

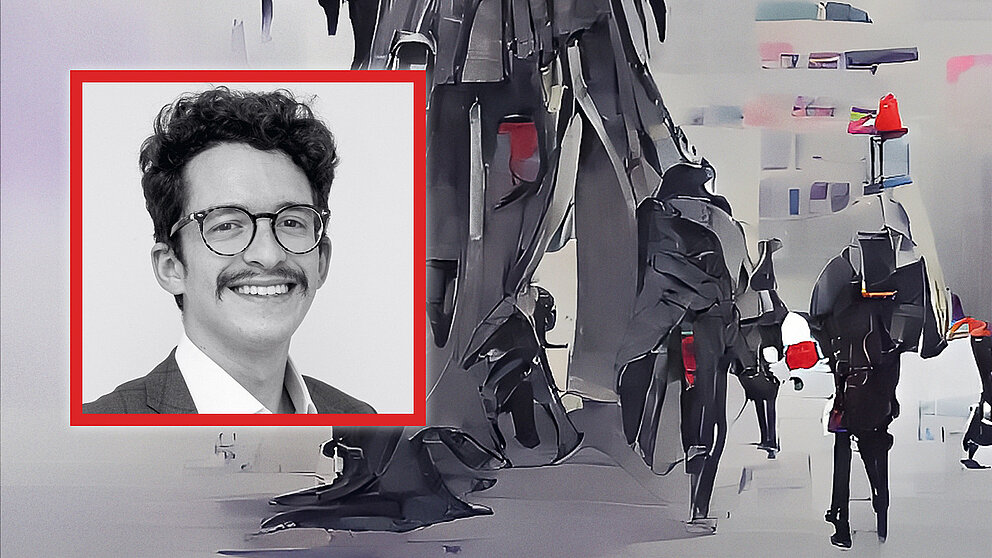

JOSÉ RENATO LARANJEIRA DE PEREIRA

José Renato Laranjeira De Pereira ist Bundeskanzler-Stipendiat am iRights.Lab Berlin und Mitbegründer des brasilianischen Thinktanks Laboratory of Public Policy and Internet (LAPIN). 2021 nahm er am Humboldt Communication Lab teil.

Mit künstlicher Intelligenz haben Anbieter digitaler Dienste ein mächtiges Instrument in der Hand. KI spielt Nutzer*innen speziell auf sie zugeschnittene Werbung zu, versorgt Menschen in sozialen Netzwerken gezielt mit Informationen, die zu ihren Interessen passen, und berechnet treffsicher Persönliches wie etwa die politische Einstellung oder sexuelle Orientierung.

„Die Unternehmen profitieren sehr davon. Aber auf Nutzerseite lauern Gefahren“, sagt der brasilianische Rechtswissenschaftler José Renato Laranjeira de Pereira. „KI kann Rassismus, Homophobie und Radikalisierung fördern, unter anderem weil sie althergebrachte Vorurteile verstärkt. Sie kann etwa Menschen mit dunkler Hautfarbe als weniger kreditwürdig bewerten. In sozialen Netzwerken wie Facebook, Twitter oder TikTok spielt sie uns möglicherweise bevorzugt polarisierende Inhalte radikaler Parteien zu, weil diese intensiver diskutiert und geteilt werden. Das erhöht die Verweildauer im Netzwerk – woran es ein Interesse gib, weil wir dann mehr Werbung konsumieren.“

Im Berliner iRights.Lab, einer Denkfabrik für die Herausforderungen der Digitalisierung, arbeitet Laranjeira de Pereira an Strategien für mehr Transparenz und Nutzerrechte. „Soziale Netzwerke wie Facebook sollten die Funktionsweise ihrer KI offenlegen. Und zwar so, dass auch Laien nachvollziehen können, wie Entscheidungen dort zustande kommen“, sagt er. „Als Nutzer sollte ich das Recht haben, informiert zu werden, warum mir beispielsweise ein homophober Inhalt angezeigt wird. Und das am besten mit nur einem Klick.“